如果你已经在用 MATLAB 做深度学习,那一定知道它的训练和仿真体验非常丝滑。但当模型要真正落地到 FPGA 上时,往往就会卡住:怎么把网络结构和权重优雅地搬到硬件里?

这就是 MathWorks Deep Learning HDL Toolbox 出场的地方。

它能干什么?

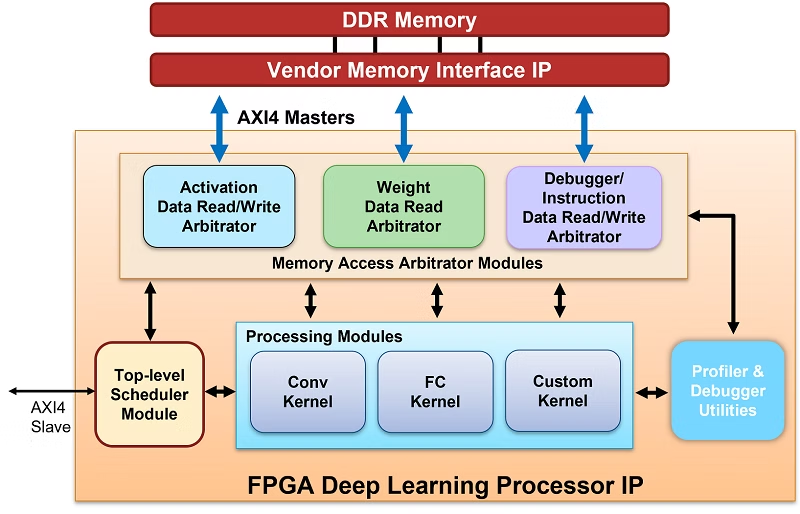

简单来说,这个工具就是把你的神经网络“翻译”成 FPGA 能跑的电路。它提供了一个现成的 Deep Learning Processor (DLP) IP 核,能直接放到 FPGA 里跑模型推理。

主要功能有:

自动生成 FPGA 工程:不需要手写 RTL,只要在 MATLAB 定义好网络结构,就能一键生成 Vivado 工程。

支持常见网络层:卷积层、全连接层、激活层等常见模块都内置好,拖上去就能用。

硬件加速 AI 推理:推理过程完全在硬件里跑,没有软件瓶颈,延迟低、确定性强。

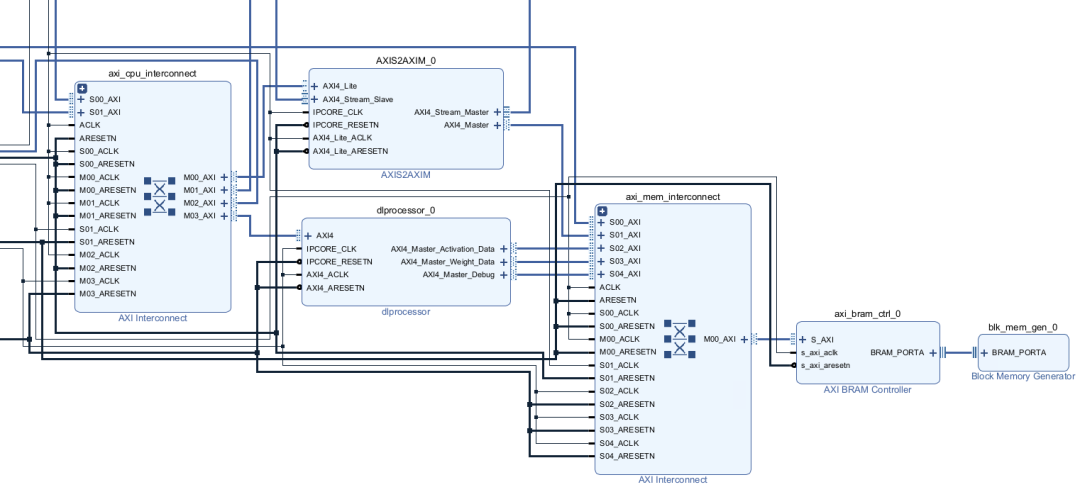

AXI 接口对接:DLP IP 自带 AXI4-Lite/AXI4-Stream 接口,方便和其他 FPGA 逻辑或外设对接。

可定制化:支持修改网络拓扑、算子精度,还能扩展自定义层。

参考设计入门

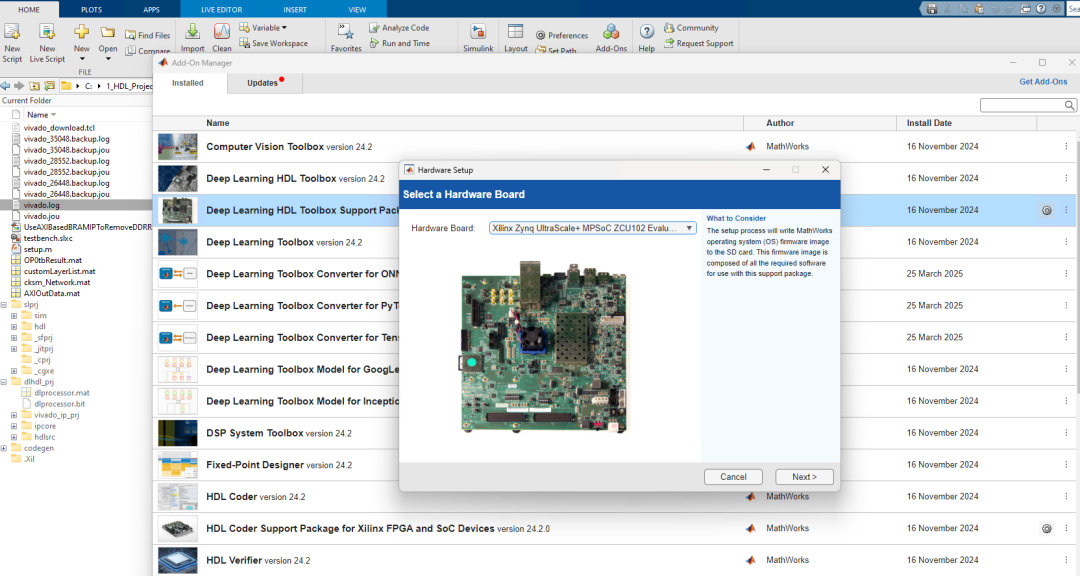

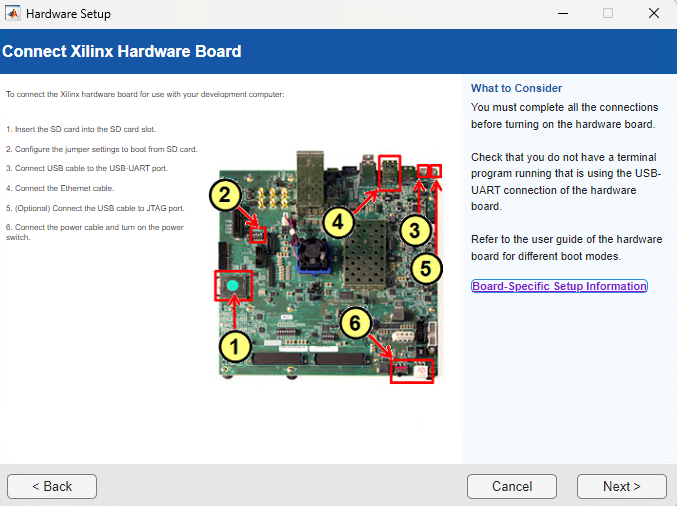

最快捷的入门方法是先在 MATLAB 中生成参考设计,然后 MATLAB 会生成一个针对 ZCU102 评估板的 Vivado 项目。该设计可以直接在 MATLAB 中使用 JTAG 接口进行测试。

设计架构概述

该架构非常简单,只需几分钟即可运行应用程序。

尽管参考设计使用了 SoC 设备,但处理器仅负责时钟和复位信号。

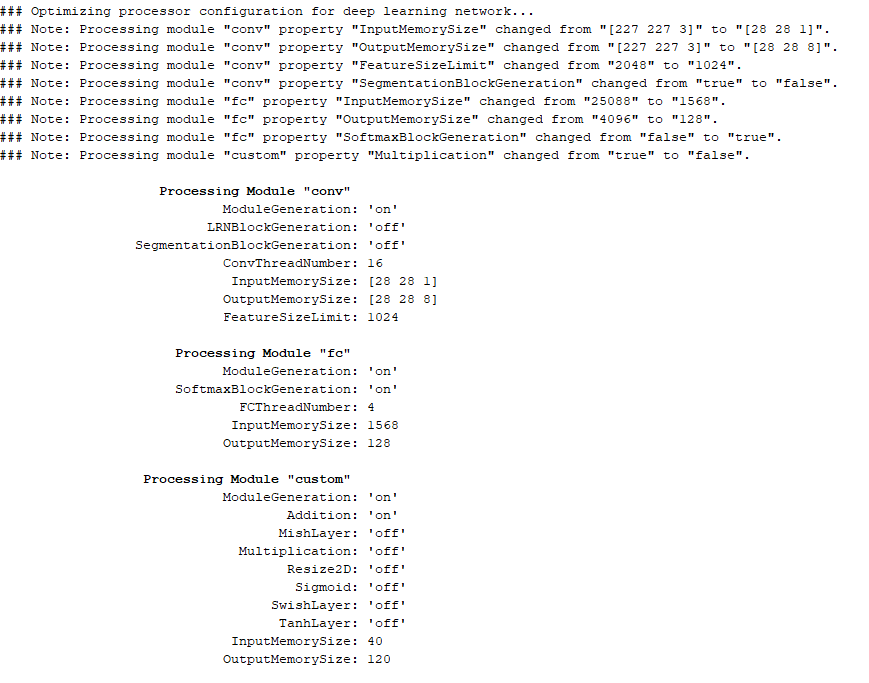

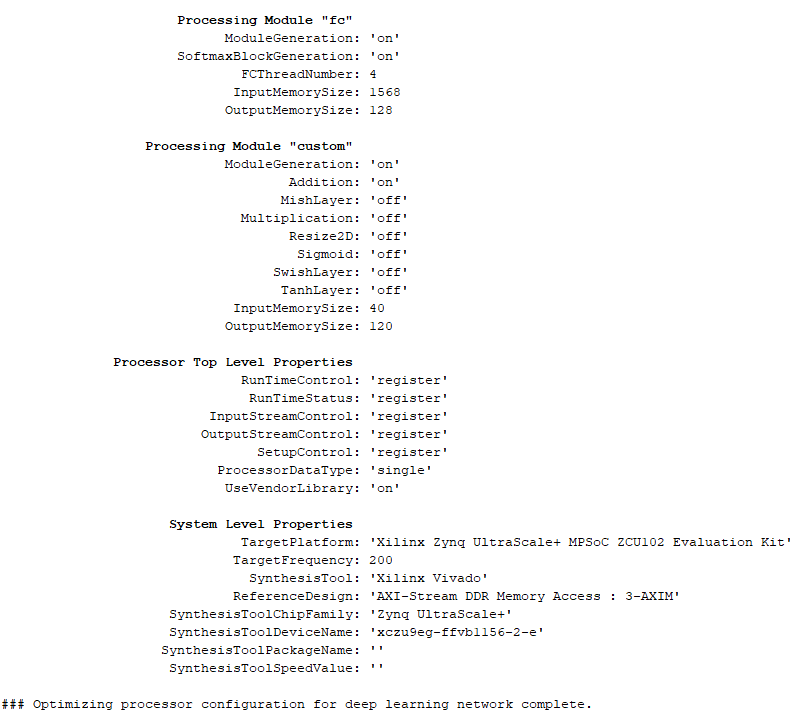

该过程从定义 DLP 及其接口的配置文件开始。

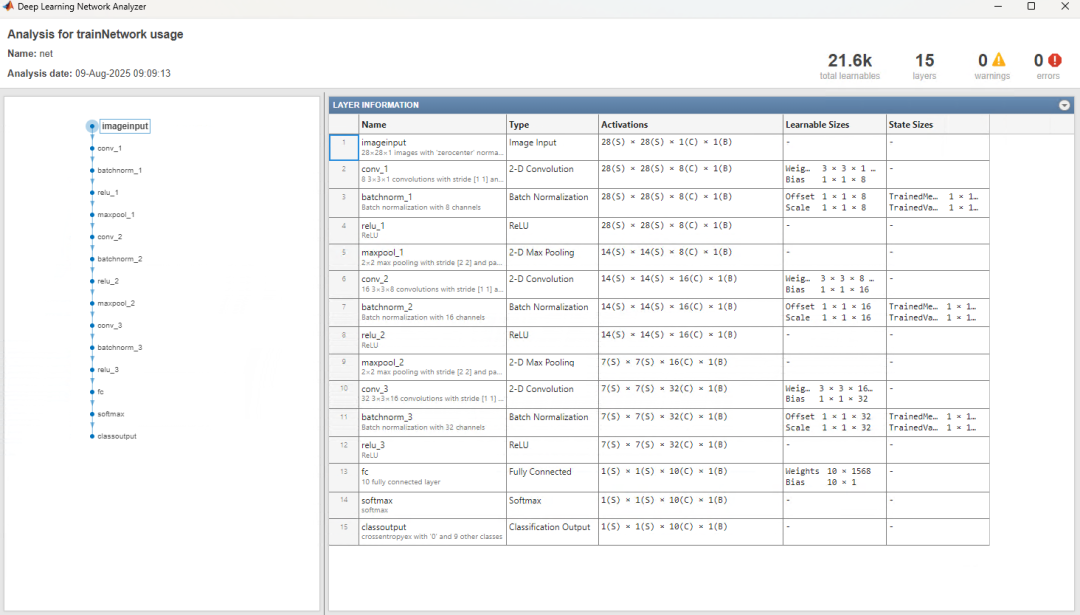

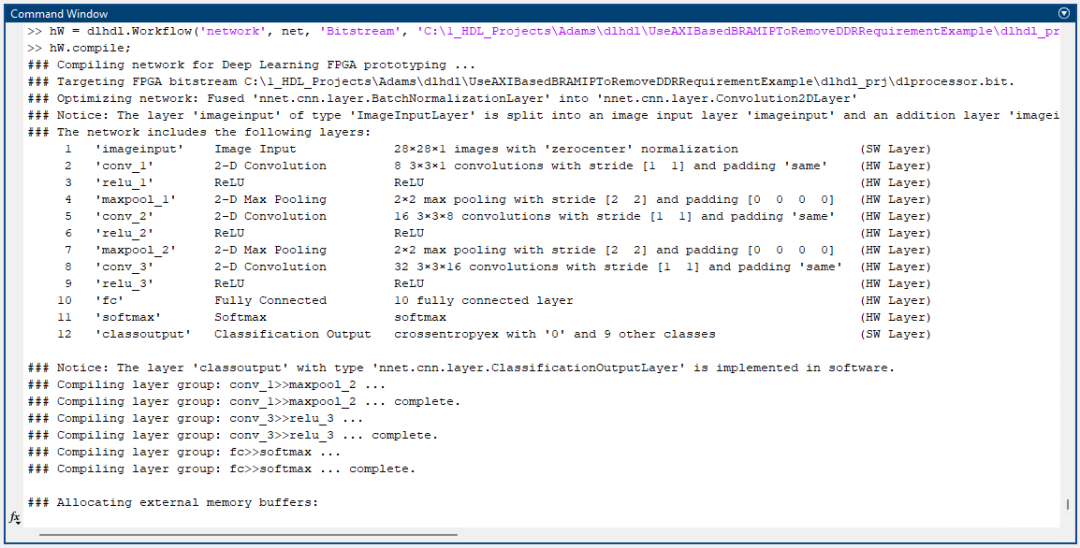

接下来,从 MATLAB 库中导入了一个预训练的MNIST 分类网络。通过分析它,我们可以了解待实现网络的结构。

定义网络后,处理器就会对其进行配置和优化。

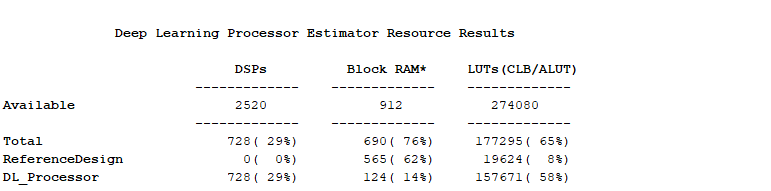

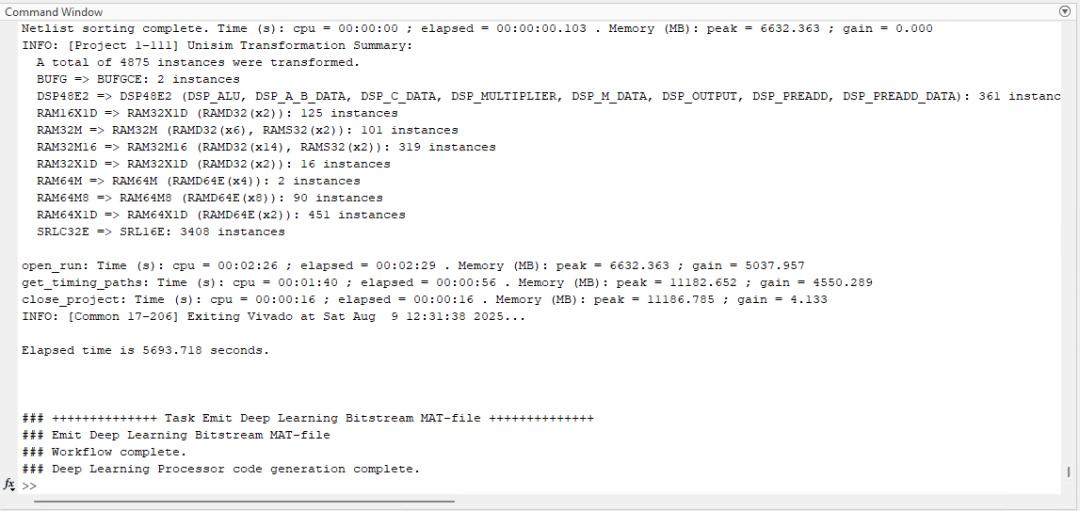

一旦处理器得到优化,我们就可以让 MATLAB 在 Vivado 中构建深度学习 IP 设计。

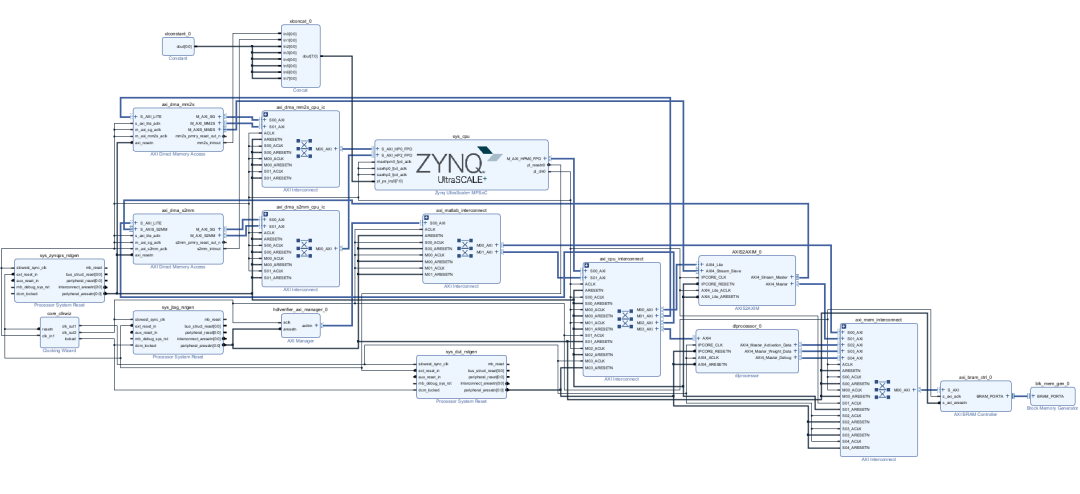

完成后就可以打开 Vivado 并探索该项目。将看到 AXI 互连、深度学习 IP 和 AXI 基础架构。

构建和运行设计

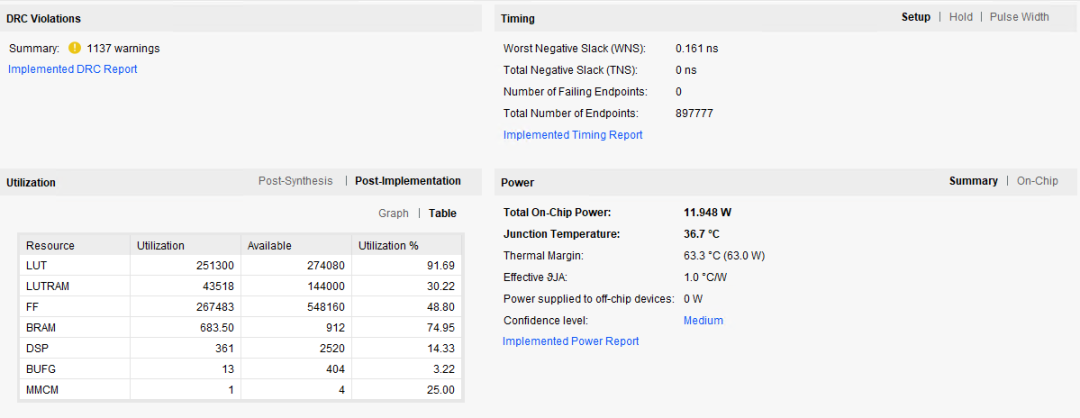

优化完成后,MATLAB 即可为 Vivado 构建 DLP IP 设计。编译只需几分钟,之后 Vivado 项目将显示 AXI 互连、DLP IP 以及相关基础架构。

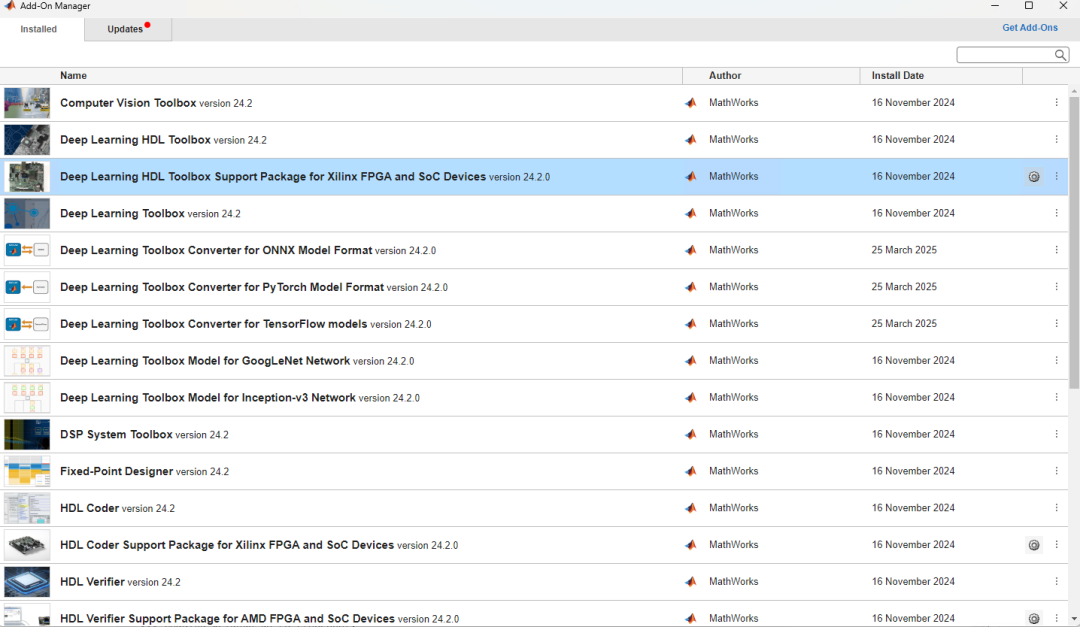

运行硬件示例之前,必须正确配置 Zynq 处理系统 (PS),否则将不提供时钟。这可以通过 从附加组件管理器安装适用于 Xilinx FPGA 和 SoC 设备的深度学习 HDL 工具箱支持包来完成。

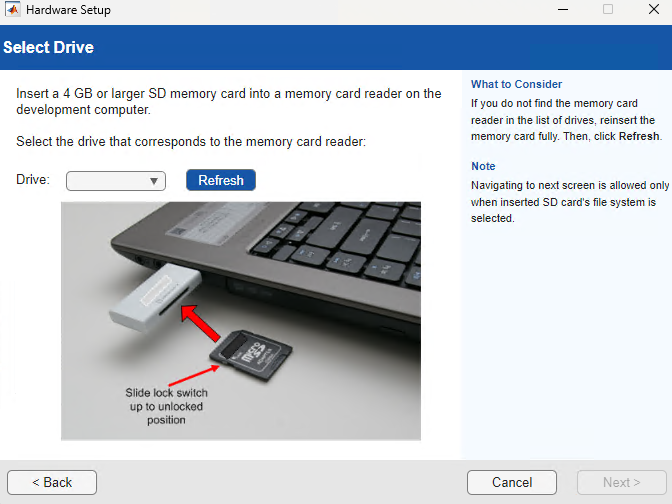

附加管理器还提供为 ZCU102 编程 SD 卡的工具,确保 PS 提供所需的时钟和复位信号。

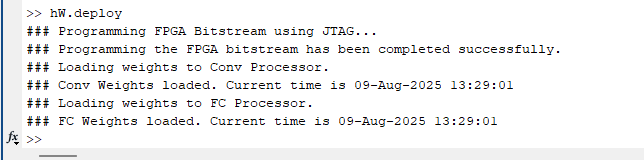

设置完成后,打开 ZCU102 的电源,将 JTAG 连接到开发板,并从 MATLAB 下载比特流。这还会使用网络的权重和激活函数配置 FPGA 存储器。

测试网络

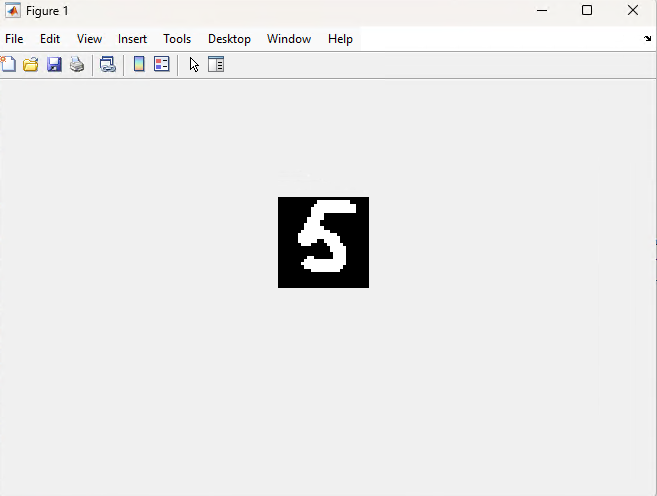

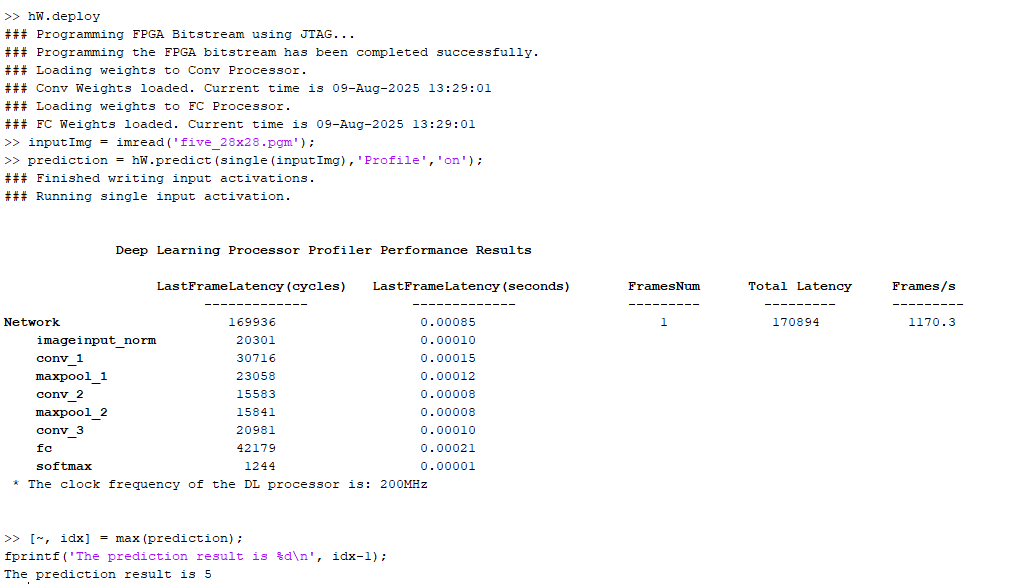

然后,加载一张简单的图像并进行推理。经过训练识别手写数字的 MNIST 网络通过 JTAG 链路返回了正确的预测。

由于启用了分析功能,可以查看推理结果和性能指标。虽然这是一个简单的网络,但速度还是很快的。

小结

MathWorks Deep Learning HDL Toolbox 其实就是一条“AI 模型到 FPGA 的高速通道”。

它帮你把 MATLAB 里的深度学习模型,直接翻译成可运行在 FPGA 上的硬件结构,还自带了一个成熟的 DLP 引擎,降低了从算法到部署的门槛。

一句话:如果你在 FPGA 上搞 AI,这个工具能帮你把“想法”快速变成“硬件”。

我要赚赏金

我要赚赏金