AT32上实现关键词语音识别(KWS)

前言

关键词识别(Keyword Spotting,KWS)属于语音识别领域的一个子领域,用户在智能设备上进行语音交互时比较常用到该技术。

2018年ARM和斯坦福大学进行了合作,并开源了预训练TensorFlow模型及其语音关键词识别代码。本文基于此开源模型和代码,在AT32 MCU上对KWS效果进行展示。

识别效果视频链接 https://b23.tv/3UNwWEH

1 KWS概述

关键字定位(Keyword Spotting,KWS)技术,已成为可穿戴设备、物联网设备和其他智能终端的关键。诸如“Alexa”,“Hey Siri”或“Ok Google”等短语唤醒智能手机和家用电器上的语音激活功能,已经是语音交互设计产品的广泛需求。

对于KWS,实时响应和高精度才能获得良好的用户体验。最近,神经网络已成为 KWS 架构的一个有吸引力的选择,因为与传统的语音处理算法相比,它们具有更高的准确性。

由于需要实时在线识别的要求,导致KWS 应用在内存和计算能力有限的微型微控制器上运行会受到一定限制。KWS 的神经网络架构设计必须考虑这些限制。于是,研究人员设计出由于传统CNN的深度可分离卷积神经网络(DS-CNN)架构技术。

为了进一步介绍了DS-CNN架构,并展示了开发人员如何在MCU上实现DS-CNN KWS。2018年ARM和斯坦福大学进行了合作,并开源了预训练TensorFlow模型及其语音关键词识别代码,并将结果发表在论文Hello Edge: Keyword Spotting on Microcontrollers中。

本文基于此开源模型和代码,在AT32 MCU上对KWS效果进行展示。

2 KWS实现原理

2.1 关键词识别KWS

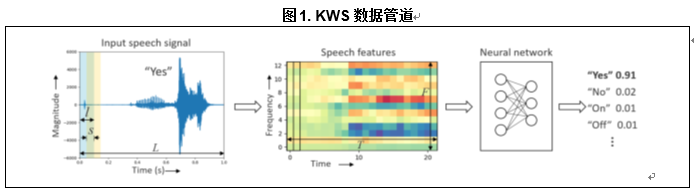

一个典型的 KWS 系统由一个特征提取器和一个基于神经网络的分类器组成,如下图所示。首先,长度为 L 的输入语音信号被分成长度为 l 且步幅为 s 的重叠帧,总共有帧T帧。

T=(L-l)/S+1

从每一帧中提取 F 个语音特征,则长度为 L 的整个输入语音信号总共生成 T × F 个特征。Log-mel filter bank energies (LFBE) 和Mel-frequency cepstral coefficients (MFCC) 常用于基于深度学习的语音识别,特别适用于传统语音处理技术。使用 LFBE 或 MFCC 进行特征提取涉及将时域语音信号转换为一组频域频谱信号,从而实现输入信号的维度压缩。提取的语音特征矩阵服务于输入分类器模块,该模块导出所输出分类的概率。在需要从连续音频流中识别关键字的实际场景中,利用后端处理模块可以在一段时间内平均每个输出类的输出概率,从而提高预测的整体置信度。

2.2 卷积神经网络CNN

基于 DNN 的 KWS 的一个主要缺点是它无法有效地对语音特征中的局部时间和频谱相关性进行建模。 CNN 是通过将输入时域和谱域特征视作图像,并对其进行二维卷积处理。卷积层之后通常是批量归一化 、基于 ReLU 的激活函数和可选的最大/平均池化层,这些处理可以降低特征的维数。在推理过程中,批量归一化的参数可以折叠到卷积层的权重中。在某些情况下,为了减少参数和加速训练,在卷积层和密集层之间添加了一个线性低秩层,这是一个没有非线性激活的全连接层

2.3 深度可分离卷积神经网络DS-CNN

深度可分离卷积神经网络(DS-CNN)。最近,深度可分离卷积已被提出作为标准 3-D 卷积操作的有效替代方案,并已用于在计算机视觉领域实现紧凑的网络架构。 DS-CNN 首先将输入特征图中的每个通道与一个单独的 2-D 滤波器进行卷积,然后使用逐点卷积(即 1x1)在深度维度上组合输出。通过将标准的 3-D 卷积分解为 2-D 卷积,然后是 1-D 卷积,深度可分离卷积在参数数量和操作方面都更加高效,这使得即使在资源受限的微控制器设备中也可以实现更深、更宽的架构。

3 例 KWS实作

3.1 KWS测试平台

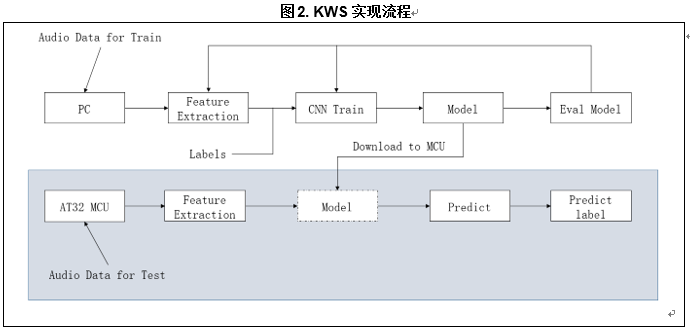

KWS系统需要使用到两个平台,即PC端和AT32 MCU端。

PC端:

利用TensorFlow与Python撰写完整的深度学习程序代码并训练模型,因本文件使用的学习模式为监督式的学习,需给系统大量的训练数据和Labels,接着将提取到的特征用以训练CNN模型,并反复修正训练的模型,直到模型为此系统优化的状态。

AT32 MCU端:

利用ARM提供的CMSIS-NN的函式库、DSP函数库和CNN函数库,结合PC端训练好的模型(该模型已下载待MCU)。对输入到MCU端的音频数据进行识别,实现对该语音数据可能的标签进行分类和预测。

因此,对于既定模型的KWS识别,AT32 MCU端可实现完全离线识别,无需实时与PC通信或联网通信。本示例,AT32 MCU端智能识别的关键词列表如下"yes","no","up","down","left","right","on","off","stop","go";

没有输入信号时,输出标签为"Silence";输入信号不在关键词列表时,输出标签为"Unknown"。

注意:由于篇幅限制,本文只介绍AT32 MCU的实现流程,如下图阴影部分。

3.2 资源准备

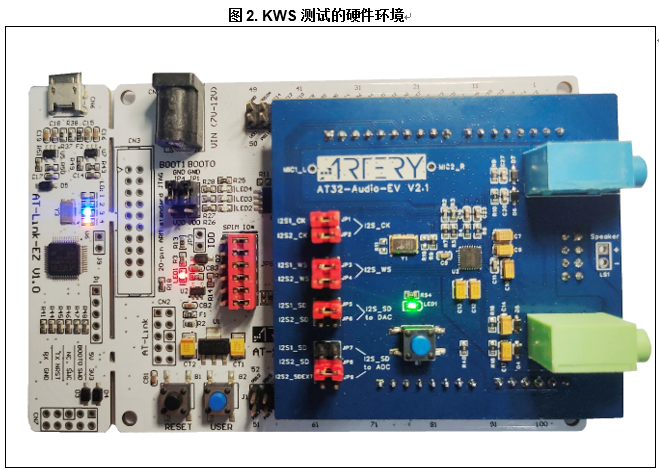

1) 硬件环境:

AT-START-F403A BOARD V1.x

AT32-Audio-EV V2.x

2) 软件环境

MDK V5.31或更新版本,使用ARM Compiler V6进行编译

…\PACK\ArteryTek.AT32F403A_407_DFP.2.1.2.pack或更新版本

…\PACK\ARM.CMSIS-DSP.1.11.0.pack或更新版本

ML-KWS-for-MCU-master\Project\mdk_v5

3.3 实验效果

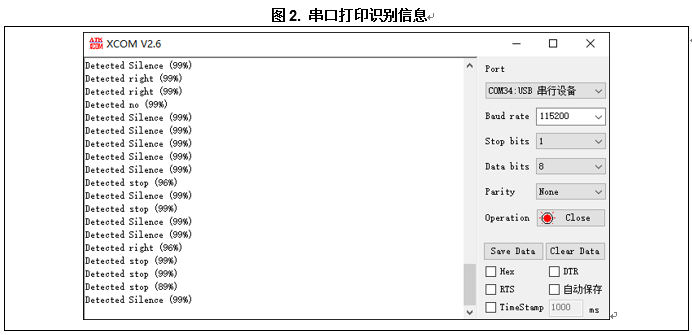

在AT32-Audio-EV V2.x端 LINE_IN输入语音信号后,AT Link虚拟串口会打印输出KWS识别的标签和概率。

识别效果视频链接 https://b23.tv/3UNwWEH

AN0148_ML_KWS_for_AT32_MCU_ZH_V2.0.0.zip

AN0148_ML_KWS_for_AT32_MCU_ZH_V2.0.0.zip

我要赚赏金

我要赚赏金