第四章,如何实现可信可靠可解释的人工智能

(方案:以磁体浮力解决电线缠绕问题,重新设计三维芯片)

怎么改变人工智障呢?如何实现可信可靠可解释人工智能?

就按照仿生办法,模仿三维神经元集群。具体的,要两步来解决。

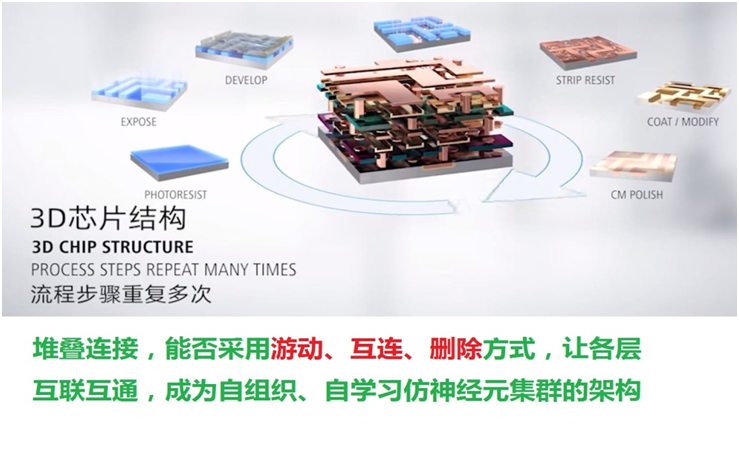

第一步,改变芯片结构,从二维芯片改为三维芯片;第二步,解决固体与流体矛盾。

第1节, 改变芯片结构,从二维芯片改为三维芯片。

先谈第9节,再回过来谈第1节的用路由器模仿神经元。

第9节,解决固体与流体矛盾。

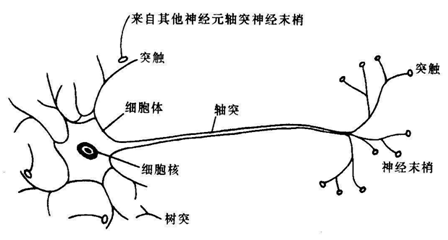

大脑骨骼是相对固态的,神经元所处的环境是液态的,便于突触游动、互连、删除。生命体内,是以固态物质作为框架,以流体传递物质、能量、信息。

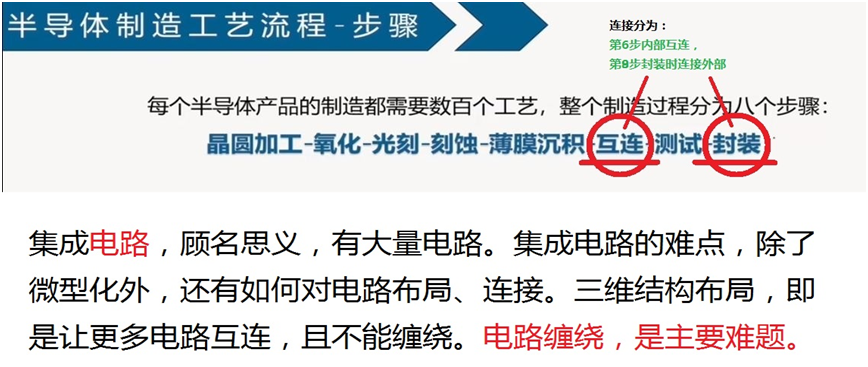

人类发明的集成电路,电线是固定的,其中的电子是活动的,以活动的电子传递信息。作者的思路是,让固定的电线,也像神经元突触那样游动、互连、删除。

前面第1节,用路由器集群的接口线路太多,会造成电线缠绕。芯片上集成电路也需要解决电路短路、断路问题。电子设计自动化(英语:Electronic design automation,缩写:EDA)的一个重要任务就是解决布线问题。数学中图论的路覆盖理论,提供了一种指导解决固定线路短路、断路问题的理论。作者没有研究过图论路覆盖理论,并不打算以路覆盖理论解决电线缠绕问题。

作者引用固体——流体理论,以模仿神经元突触末梢游动、互连、删除的方式,解决电路短路、断路问题,即解决电线缠绕问题。

所以,实现三维芯片的方案,就是找到一种既是固体、又能克服重力、还能流动的便宜材料,以此材料为基础的技术就可以解决三维芯片无数连线、无数开关问题。

这种便宜的材料,在现实中早已经存在。本节会讨论该便宜材料的使用方法。

太空微重力环境对解决固体与流体矛盾有巨大帮助。太空,是天然的微重力环境,比地面更好。这种便宜的材料既可以在地面使用,如果到太空使用,更节能,也能解决人在太空失重环境下需要昂贵的生命保障系统问题,有利于将来向太空进发。现阶段,还是以地球重力环境下讨论此材料如何解决电线缠绕问题。

这种材料就是常见的磁体。磁体发出磁力,可以克服地球重力,并引导连线模仿神经元突触的连接,即线路接头套上磁头,以可控磁力控制接头连接或脱离接触。这可以称为磁控接头移动技术(轼辙结合技术,轼相当于固定线路,辙相当于游动线路)。

但磁力与电路中电流会互相影响,磁力对其它元器件也有影响,所以必须屏蔽或增大间隔,或者将来采用对磁力不敏感的光计算芯片。

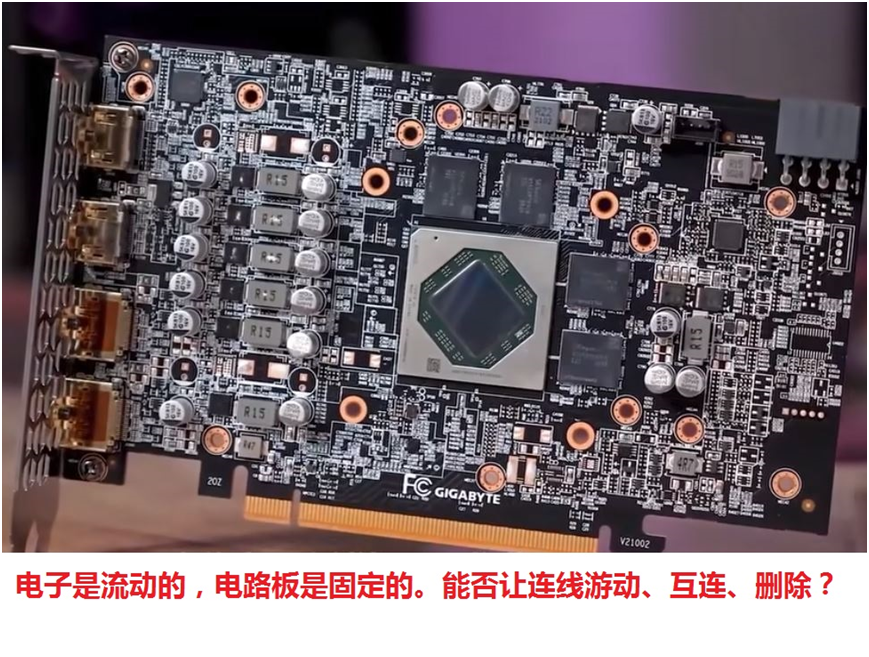

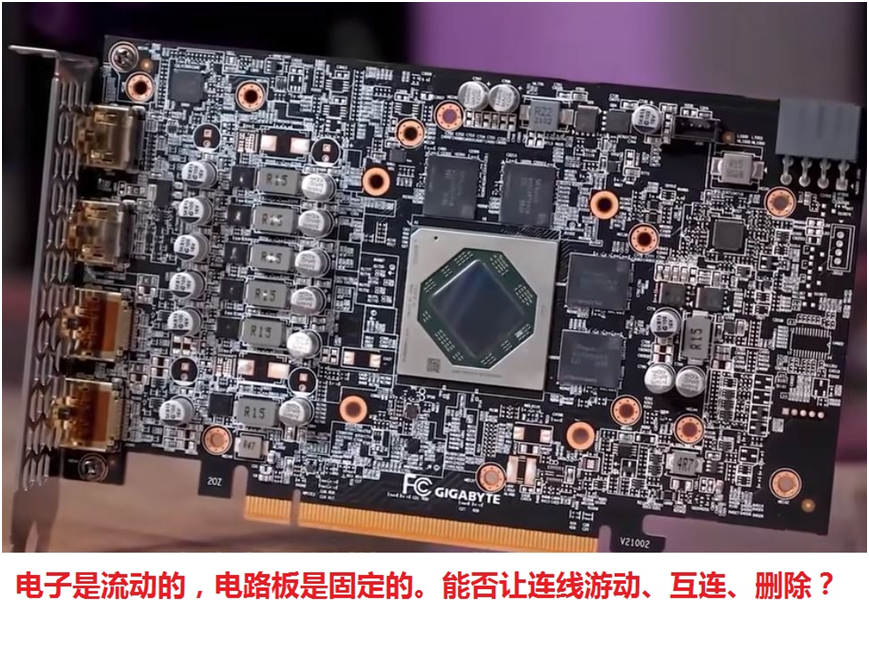

现在的芯片,连线已经太多太复杂,且连线是固定的,只有连线中电子是流动的。

集成电路的发展方向,除了微型化方向,还可以在固体——流体理论指导下,模仿神经元间可活动的、可删除的突触连接方式,让电路间连接可活动、可删除。

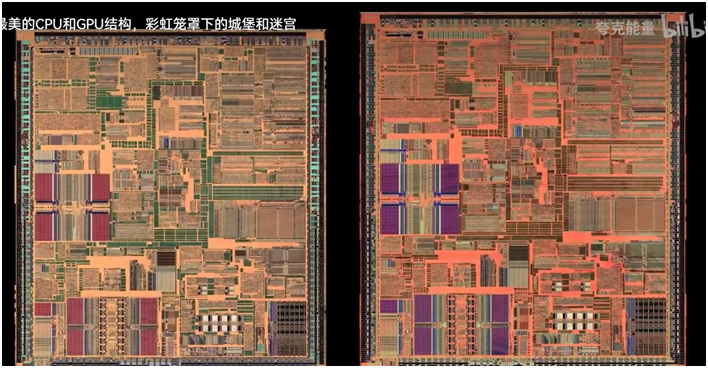

这是20世纪70年代芯片,电路远没有21世纪芯片复杂。

这是21世纪初计算机芯片。

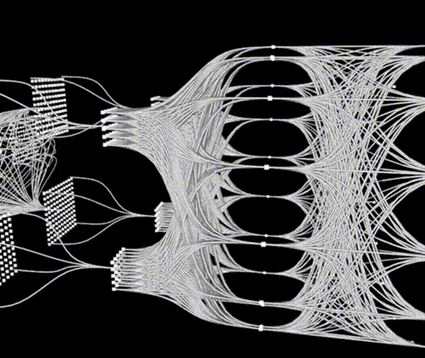

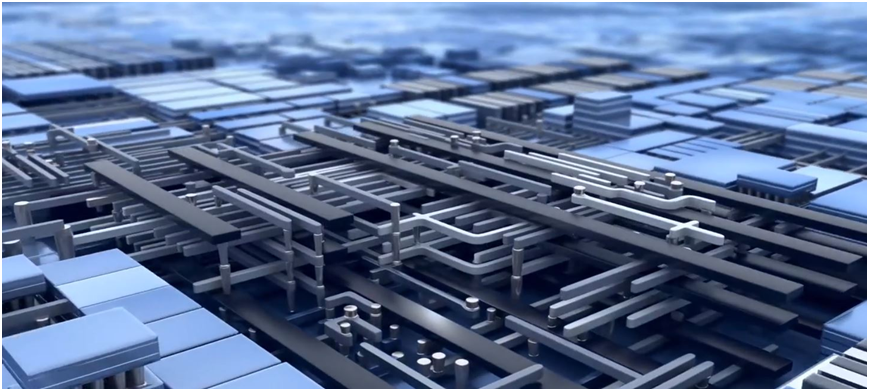

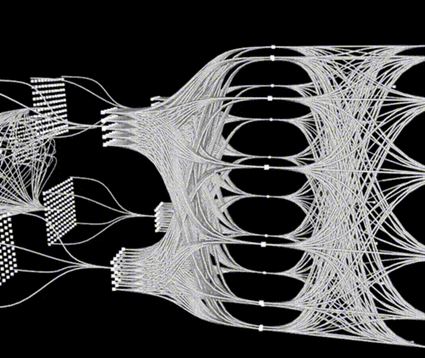

这是当今芯片的模拟图,连线非常多。

现阶段,还无法实现芯片内部叠层间连线游动、互连、删除。芯片内部叠层连线接头可移动,这是将来长远目标。

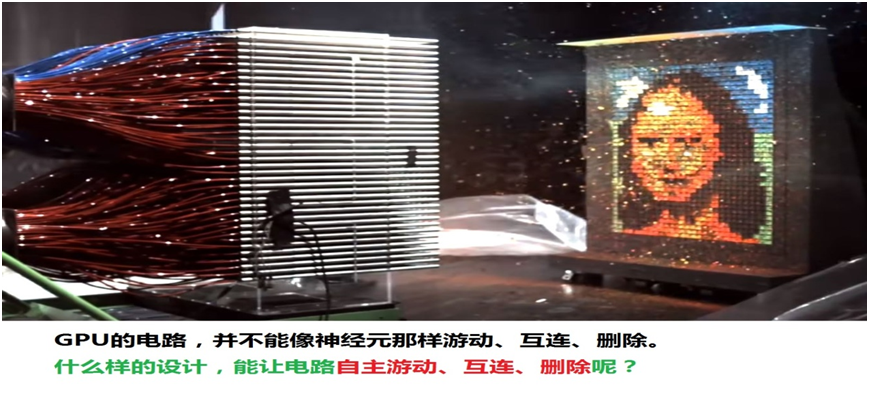

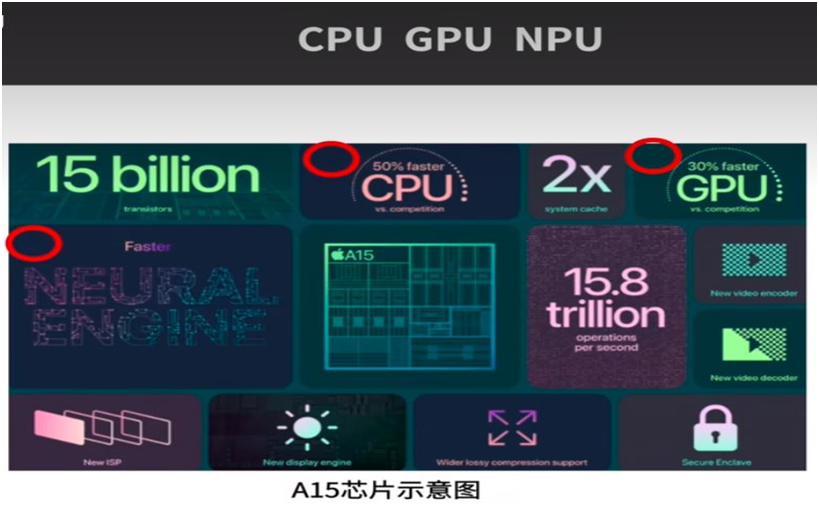

再看一张形象图。这是英伟达发布会对GPU的示例。

但可以尝试,在芯片群之间采用磁控接头移动技术(轼辙结合技术,轼相当于固定线路,辙相当于游动线路)。

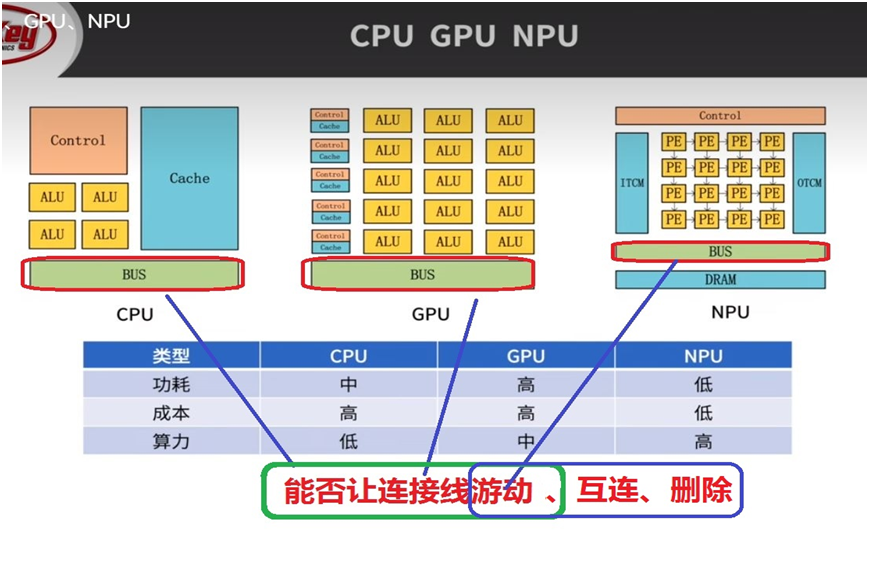

CPU、GPU、NPU之间连线,可以尝试采用磁控接头移动技术(轼辙结合技术,轼相当于固定线路,辙相当于游动线路),从而在硬件方面模仿神经元间可活动的、可删除的突触连接。

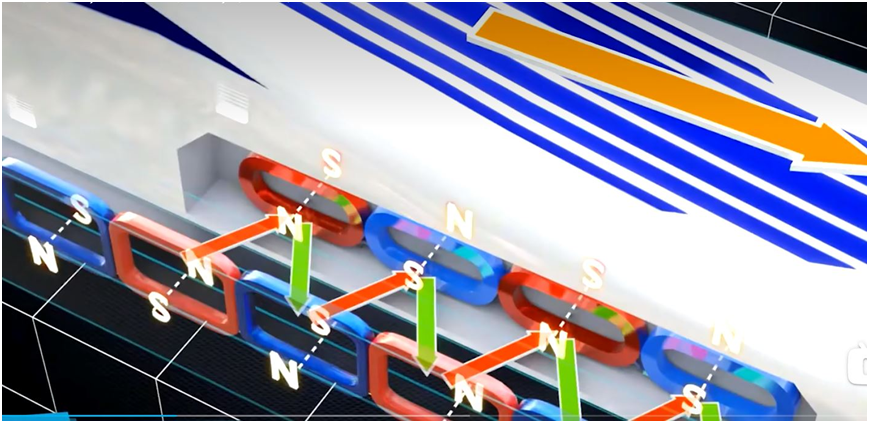

磁控接头移动技术(轼辙结合技术),是怎样的呢?大家在生活中是常见到的。

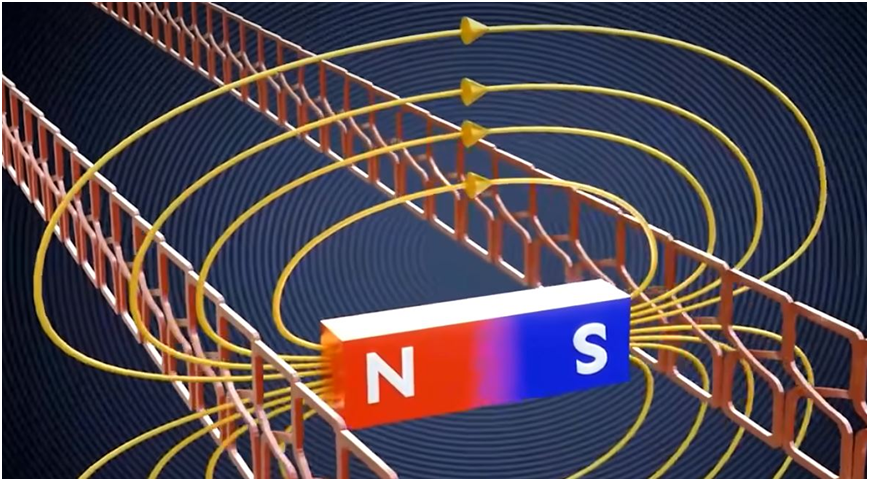

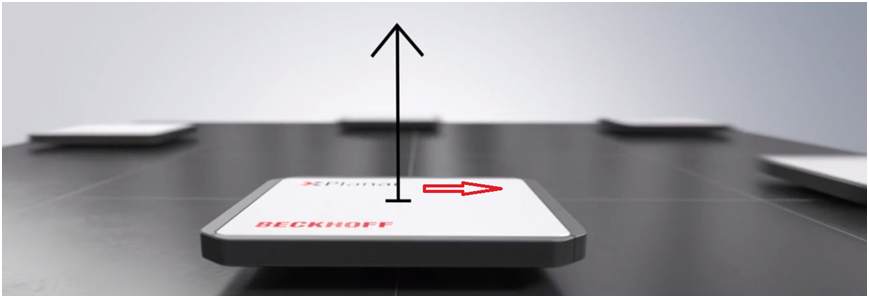

这几张图,即演示了磁控接头移动技术(轼辙结合技术)。

磁控接头移动技术(轼辙结合技术),可以实现磁平面无接触的平移、升降。

电线接头套在磁平面上,接头随磁平面移动。而指挥控制磁平面的,又是接头所连的芯片。

先把芯片整体当做一个神经元胞体,芯片外连电路就像突触,接头就像突触末梢。而磁平面受控于芯片,芯片指挥磁平面带着接头,模仿突触的移动、接触或脱离。

将来,在芯片内部,尝试在叠层间连线采用磁控接头移动技术(轼辙结合技术),以解决芯片内部线路缠绕问题。

磁控接头移动技术(轼辙结合技术),其技术的缺点是非常明显的,即接头移动速度非常慢,远远不如固定连线开关。而且,变化的磁力会影响各种元器件运行,必须留出足够隔离空间,这会大大增加电路板体积(将来,对磁力不敏感的光计算芯片成熟后,可以降低电路板体积)。

如果是为了数值计算,传输数据的连线尽可能是固定的,固定的连线才能传输大数据。

而另一类需求,即为了在硬件层面模仿神经元集群,则芯片间连线可以先尝试用磁控接头移动技术(轼辙结合技术)。机柜的空间较大,可以容纳大体积的电路板,电路板上芯片间距可以放得很大,以安装磁体定子、磁平面动子等元器件。

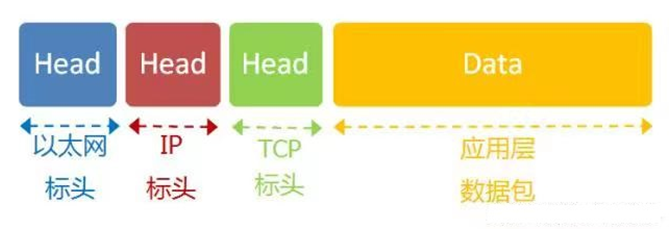

这类模仿神经元集群的芯片群组,其传输的数据格式,可以模仿TCP/IP数据格式,即前几位是芯片地址。同时不完全照搬TCP/IP数据格式,而是有改动,即改为可读写应用层数据包内容。

上一节,用路由器模仿神经元时,路由器不会读写应用层数据,路由器就像信使,没有必要让信使读写信件内容。路由器间的学习,是互相学习路由表,并计算路由途径。这是路由器间的自学习、自组织。

而芯片群,既可以通过交换路由表而学习和组织起来(读写TCP/IP数据标头),又通过交换其它数据如数值、函数、图形而学习和组织起来(读写TCP/IP应用层数据包),还能模仿神经元集群用连线实现分解、构建三维音画、抽像、记忆、联想、复杂推理 等功能。

至此,在序列-结构-运动-功能的理论体系里,作者探讨了现有芯片的两大瓶颈。一个是结构上瓶颈,摩尔定律逐渐失效,集成电路很难再微型化,于是芯片逐渐朝3D方向发展,不断堆叠,堆叠导致了电路连线复杂,极易缠绕。作者提出,利用磁控接头移动技术(轼辙结合技术)解决电路连线缠绕问题。磁控的连线接头,模仿突触末梢,可移动、可互连、可脱离、可删除。芯片之间数据结构,模仿TCP/IP协议,加上地址头,可寻址。

第二个功能上的瓶颈,现有人工智能技术大多是改进函数,通过纯算法虚拟搭建仿神经元突触式连接。导致功能的瓶颈的原因,除了芯片结构的原因,就是芯片内部连线、芯片外部连线是固定的。

作者提出,利用磁控接头移动技术(轼辙结合技术)从硬件芯片上真实搭建仿神经元突触式连接。磁控的连线接头,模仿突触末梢,可移动、可互连、可脱离、可删除。芯片通过自学习、自组织,实现正负反馈、自动修正,以及分解、构建三维音画、抽像、记忆、联想、复杂推理 等功能。

磁控接头移动技术(轼辙结合技术),既解决了电路连线缠绕问题,又模仿了神经元突触式连接,在结构-运动-功能三个层次都改进了现有计算机硬件,为计算机软件开发提供了更高层次的硬件基础。

结构-运动-功能三个层次要得到改进,前提是EDA在设计人工智能类脑芯片时,就把磁控接头移动技术(轼辙结合技术)运用于解决电线通道缠绕问题。

但读者可能会提问,在当今移动互联网发达的社会,是否可以把数据中心的服务器、路由器比作神经元胞体,是否可以把移动终端比作突触末梢?为何移动互联网没有“觉醒”成恐怖的天网?

作者完全认同以上形象的比方,并相信将来移动互联网会“觉醒”出智能。

但是,前提是做出两个改变。第一个改变是,服务器、路由器必须能读写TCP/IP数据,从标头到数据包。第二个改变是,服务器、路由器能指挥所有通讯节点间的物理接触或脱离,而现在的通讯节点间物理接触或脱离都是由人手动实现的,并且配IP地址这活儿几乎也是手动输入。下一章,作者将继续探讨这个问题。

倒叙完了,先谈了第9节,再回到第1节。

第1节,改变芯片结构,从二维芯片改为三维芯片

现有人工智能界,从用一维CPU改为用二维GPU,到华为的达芬奇结构,还有chiplet结构,还有神经拟态芯片,都在不自觉的向三维结构发展,但还不是真正的三维结构。

如何改为真正三维结构?有多种办法,如模拟生成真实神经元,又如把硅晶片做成 三维立体的,如此等等,有好几种方法可以改为三维结构。

关于生成真实神经元集群,作者以前设想,采用CRISPER技术切割DNA,单独培养神经元集群。这么做的伦理道德风险,是非常大的,而且成本高,效益低。成本高,原因是明显的,培养一个活体,需要昂贵复杂的生命保障系统。效益低,原因也是明显的,生物受地球重力影响,其体积重量是有限定的,那么人脑神经元集群的数量 也是有极限的,那么其智商也是有极限的。现在,国外又爆新闻,在大鼠脑袋里植入人脑神经元。是不是国外放松了 伦理道德审查标准?还需要观察。

作者也曾设想,把硅晶体做成三维立体的,但并未找到 在硅晶体内部刻画线路的方法。

而本书开篇第一章,介绍一种宏观的 模拟三维结构的方法:联系电信运营商的机房,在凌晨时,用路由器模拟 神经元胞体,用电线模拟突触。因为机房路由器集群数量 比神经元集群数量少得多,所以初期图灵测试时,用简单的测试:在黑色背景图中找出 手写白色阿拉伯数字。

但难度也是显而易见的,蚂蚁的神经元数量约25万个,人脑神经元数量约860亿个。路由器体积庞大,占地、耗能,如果让由路由器集群 模仿万亿神经元集群,其占用空间非常大,其耗能也非常大。

现在前沿的研究,是忆阻器,还有光芯片,等等,但没有看到特别大的进展。

以上几种办法都有缺点,或者成本很高,或者有伦理道德风险,或者很耗能,或者占用空间大,或者技术不成熟。

特别指出,路由器集群,即使缩小再缩小,也无法完全 模拟神经元集群,因为电线会缠绕。导致缠绕的根本原因是,流体与固体的区别。作者找到了解决方法,读者可以在研究中使用,这是下一节探讨的内容。

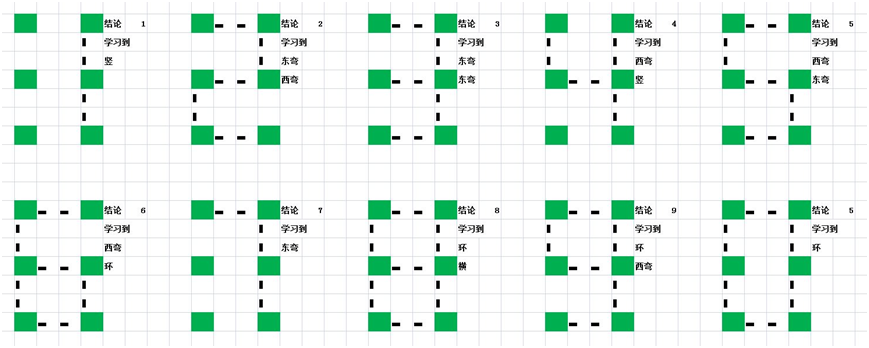

本节,探讨模仿神经元集群时的一些细节,如集群内组合问题。

相对于CPU、GPU芯片,互联网节点 更加具备模仿神经元的基础。特别是路由器,可以模仿胞体与突触……

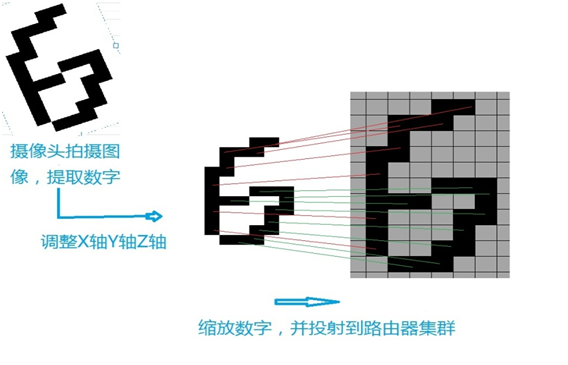

以识别数字6为例,探讨如何用路由器模仿神经元。

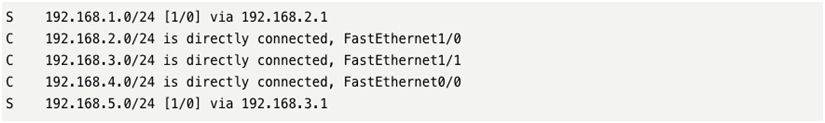

上图示例,从一张图片中提取数字,现有技术不模仿神经元集群,就能轻松完成了。

第一步,检测有数字的地方,也就是确定数字的x轴y轴位置,这第一步,现有摄像头技术已经可以检测了。眼睛的聚焦,是靠神经元集群来实现的。本书虽然尝试用路由器模仿神经元,但是聚焦功能,不是本节讨论的重点,在此,就用摄像头技术来聚焦了。

第二步,把待识别数字旋转,也就是以z轴旋转,这第二步也是现有摄像头技术可以完成的。人或动物,是由神经元集群指挥头部偏转以旋转眼睛的。为了简化,在此,就用摄像头技术来聚焦了。

以上步骤,是现有技术可以实现的,可以用摄像头聚焦后数字后,再把像素投射到路由器集群上,路由器集群再汇总缩微成 标准日字型数字。

神经元群实现聚焦、旋转,缺点慢。

摄像头搭配芯片来实现聚焦、旋转,优点快。

读者会疑惑,既然速度慢了,为何多此一举?作者这里想表的是,路由器集群可以模仿神经元集群。

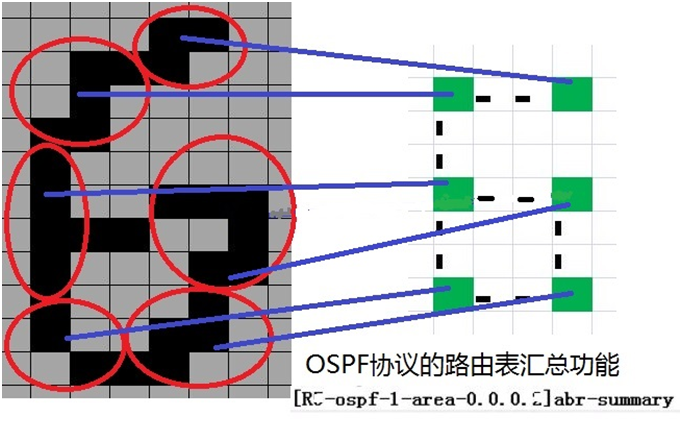

第三步,缩放待识别数字。这步用路由器的汇总路由表功能,即可实现。汇总功能,相当于神经元集群的抽象功能,简化了图形。

以下这几步,是一个生成路由表的逆过程。

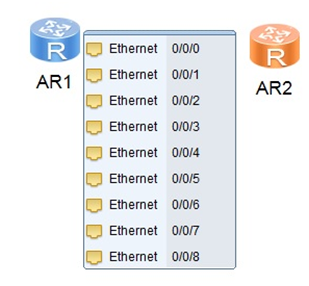

路由器接口越多,越能接收更多邻居路由器的路由表。接口是双向传输路由表,既能当入口,又能当出口。

熟悉路由协议的读者,有比作者更好的方案以识别数字。作者在此提出自己的具体步骤,

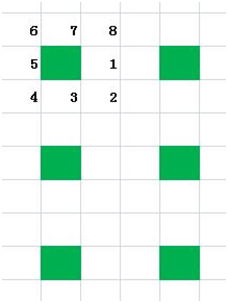

第一步,路由器判断自己是在起始点q还是经过点j还是末端点d,判断依据是8个接口打开了几个,路由表传输的方向。

如果路由器只有一个接口打开 且没有接收到路由表,则认为自身是起始点d,接口为出口,那就从出口发出<路由表> 并等待回复

如果路由器有二个接口打开,则认为自身是经过点d。d路由器把自身打开的两个口填到<路由表>里,并从出口传递给邻居路由器。

如果路由器有三个接口打开,则认为自身是经过点d且还是环的末端点d,那就检查自身是否已在<路由表>里,如果不在表里就添加到表里,并从出口传递给邻居;如果自身已在<路由表>里,则从第一个入口传出<图形表>。根据这三个接口方向,以及回传图形表,可以判断是弯、还是环。

第四步,<路由表>被传回到起始点d路由器,作为学习的结果,即结论是数字几。

这样的学习,是模拟神经元集群的连接。

学习后,对新输入的待判断的图形,反向比较起始点q、经过点j、末端点d是否相似。比较是否相似,在神经元集群里就是神经元是否被连接并传输递质。路由器比较是否相似,可以用大规模集群模仿神经元集群,但本案例里路由器数量很少,只能借助通用计算机的算法。(算法很多,比如,先把上下左右四方命名为北南东西,再把图形最大化分解原则,能分解成环的就不分解为弯,以此类推,环>弯>竖>横。)

通用计算机根据<路由表>,判断图形与数字几相似后,标注出结论,给出<判断依据>,并把<判断依据>和结论加入TCP/IP应用层数据包 发给起始路由器,起始路由器再泛洪发给其它路由器,这就是规则的形成与传播(路由器不能读取TCP/IP应用层数据包,只能由通用计算机读写数据包)。该规则是路由器自身制定、传播修改的,这就是“自组织、自学习”。整个过程体现了正负反馈、自动修正。

读者会有很大疑问,以上过程,增加了路由器集群硬件,比单独的一台通用计算机麻烦,速度又慢。据了解,谷歌的图片****,通过大量样本学习,已经可以识别大部分街景里门牌号了,也识别能其它图片。而且,用模拟器模拟路由器时,也是调用的通用计算机,这与抛开路由器,直接使用函数算法配上通用计算机,有何区别?

以上的比较相似性,是不需要大量样本的,甚至可以只需一个样本即可完成学习。

以上的日文,只需看几遍,人脑即可学会辨识其手写体。作者相信,路由器集群也只需看几遍,即可学会辨识其手写体。

这就是模仿神经元集群的学习,少量样本,或者只有一个样本,即可完成学习。甚至,样本不齐整,路由器集群也可以模仿神经元集群,也实现联想、想象、推理功能。不仅如此,路由器集群也能理解这些图片的含义。

虽然,现在有很多函数算法配上通用计算机,通过大量样本学习,能够识别手写数字了,但是依据这些算法理解图片真正含义,有很大难度。更进一步的,若用这些函数算法理配上通用计算机,即使读取大量样本数据,依然在区别猫狗、理解道路标志意义、指导自动驾驶、理解语义、揣摩心理等等方面,没有突破性进展。

特别是学习驾驶技术方面,王垠(www.yinwang.org)说得非常好,成年人几个小时就能学会驾驶,避障、识别道路标志等简直是轻而易举。但计算机吞入了大量数据,依然不明白何为驾驶、避障、识图。

用路由器集群模拟神经元集群,是区别于函数算法配一维CPU二维GPU虚拟化连接神经元,另一条真实物理连接神经元的方式。

每个路由器都可以生成路由表,相当于一个神经元。而生成这么多路由表,怎么传递,怎么终止,是各个路由器互相学习过程、互相取舍的过程,这就相当于神经元集群互相触发的过程、互相抑制的过程。

在作者有限的认知里,这就体现用路由器集群的好处:简单的分解式学习、屈指可数的样本数据、很弱的计算力、低能耗,通过路由器之间正负反馈、自动修正,就能实现避障、识图,配上足够多路由器就能实现语义理解。

这是中心计算模式,与分布式计算模式的区别。

现在CPU、GPU在勉强模仿神经元集群,意图实现真正智能,但其实还主要应用于看图说话等等 不影响安全的领域,如智能音箱。即使预测蛋白质序列,也是用计算机的数值计算功能,而不是理解蛋白质序列的意义。

而路由器集群,模仿神经元集群,应该比CPU或GPU干得好得多。

因为,已有实践已经确认,在并行计算方面,CPU不如GPU。

现在,作者提出把路由器集群代替GPU,扩展GPU里每个计算单元的能力,赋予每个GPU单元一套路由算法。

虽然单个路由器里小小的芯片计算力很弱,但路由器集群在互相学习、互相取舍,这个学习、取舍过程,才是作者以前文章里说的“正负双向反馈、自动调整过程”。

用复杂系统学来解释,就是路由器集群有了“自学习、自组织”能力。而“自学习、自组织”能力,是集群实现智能的关键步骤,鸟群、蚁群、人群都是“自学习、自组织”的非中心计算形态。这与基于中心大CPU计算的形态,完全不同。

复杂系统论理论,是个大理论。

复杂系统论认为,集群会涌现出更高层次事物。鸟群、蚁群、黏菌,涌现出的智能,是无法用单个个体解释的。用路由器集群模仿神经元集群,也是一条实现人工智能的可行之路。用函数算法配上通用计算机,之所以在语义理解、自动驾驶方面所遇到的瓶颈,就是因为其不采用集群而是盲目的扩大算力、读取大量数据、只用函数解题造成的。

作者认为,只要认准一点,在实践中已经证明,并行计算的GPU,比中心计算的CPU,更适合模仿神经元集群来实现人工智能即可。

所以,作者认为,在发展并行计算方面,在模仿神经元实现人工智能方面,大CPU<<GPU<<路由器集群。

(致读者,有愿意一起写的吗?

)

)

第2节, 模仿神经元集群的机制:投****机制(待续)

问答,加15983338666

第3节,模仿神经元集群的机制:补全机制(待续)

第4节,模仿神经元集群的机制:删除机制(待续)

第5节,模仿神经元集群的机制:联想机制(待续)

第6节,模仿神经元集群的机制:想象机制(待续)

第7节,模仿神经元集群的机制:推理机制(待续)

第8节,模仿神经元集群的机制:其它机制(待续)

第一章,验证:用路由器集群仿生神经元集群

第二章,作者眼中的 智能以及人工智能

第1节,定义:智能、人工智能

第2节,神经元集群运作方式:分解、抽像、重建、正负反馈等

第3节,神经元集群的动力源

第三章,比较:现有芯片的功能,以及与智能的差别

第1节,功能差别:智能与智障的差别

第2节,导致智障的原因:序列-结构-运动-功能不同

第3节,结构差别

第4节,运动方式差别

第四章,如何实现可信可靠可解释的人工智能

第1节,改变芯片结构:三维重构

第2节,模仿神经元集群的机制:投****机制

第3节,模仿神经元集群的机制:补全机制

第4节,模仿神经元集群的机制:删除机制

第5节,模仿神经元集群的机制:联想机制

第6节,模仿神经元集群的机制:想象机制

第7节,模仿神经元集群的机制:推理机制

第8节,模仿神经元集群的机制:其它机制

第9节,解决固体与流体矛盾

第五章,可信可靠可解释人工智能 对地球社会的影响

第六章,向太空微重力出发,组装太空人

第七章,太空人的体积重量

第八章,太空人的宇宙观以及人格特质

第九章,太空人与地球霸主的关系

我要赚赏金

我要赚赏金